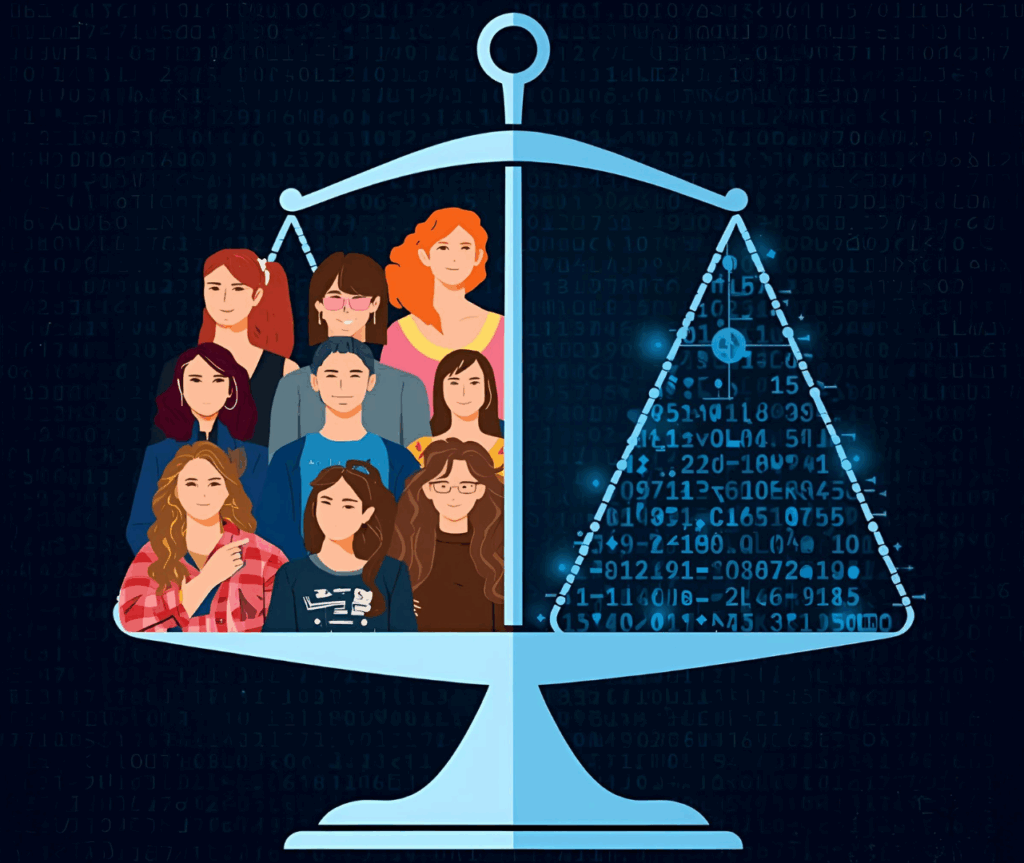

La inteligencia artificial (IA) se ha convertido en una herramienta clave en nuestra vida diaria. Sin embargo, uno de sus mayores problemas es también uno de los más invisibles: los sesgos, que además de reproducir prejuicios ya existentes en la sociedad, pueden aumentarlos de forma silenciosa

Imagen creada con IA

Los sesgos en la inteligencia artificial (IA) son distorsiones o prejuicios que aparecen en los resultados de los algoritmos. Pueden tener origen en los datos que se usaron para su entrenamiento, en las decisiones de diseño o incluso en la homogeneidad de los equipos que los desarrollan. Esto provoca que la IA refleje discriminaciones por género, etnia, edad, cultura o estatus socioeconómico, entre otros factores. El reto es que, en demasiadas ocasiones, estos sesgos no son fáciles de detectar, lo que aumenta el riesgo de que se perpetúen sin control.

Tecnologías donde los sesgos son más evidentes

Los sesgos no afectan a todas las áreas de la inteligencia artificial por igual. Algunos de los ámbitos más críticos son:

- Aprendizaje automático (Machine Learning): depende de grandes cantidades de datos, que con frecuencia no representan la diversidad social.

- Procesamiento del lenguaje natural (PLN): asistentes virtuales y sistemas de recomendación pueden reproducir estereotipos presentes en los textos con los que fueron entrenados.

- Visión por computadora: el reconocimiento facial ha mostrado problemas al identificar a mujeres o personas racializadas, funciona mejor con hombres de piel clara.

- Sistemas de búsqueda y recomendación: al priorizar la personalización, pueden encerrar a los usuarios en categorías que refuerzan sus creencias previas.

Ejemplos de sesgos en la vida real

Diversos estudios y casos mediáticos han demostrado cómo estos sesgos se manifiestan en herramientras digitales:

- Sesgo de género: asistentes virtuales como Siri o Alexa suelen tener voces femeninas, reforzando estereotipos de roles serviciales.

- Sesgo racial: en 2015, Google Fotos clasificó erróneamente a dos personas negras como “gorilas”.

- Sesgo de edad: apps de citas como Tinder han sido criticadas por discriminar a usuarios de mayor edad, aplicando precios distintos que con los más jóvenes.

Estos ejemplos ponen de relieve cómo la tecnología no es neutral y cómo puede afectar a la vida cotidiana de millones de personas.

Riesgos de los sesgos en la IA y cómo reducirlos

El principal peligro de los sesgos es la discriminación, que puede reproducirse en ámbitos clave como el laboral, el sanitario o incluso en el sistema judicial. En Europa, la nueva regulación de inteligencia artificial ya reconoce que los sistemas que afectan a la educación, la seguridad o la justicia deben considerarse de alto riesgo precisamente por este motivo.

Aunque eliminar por completo los sesgos parece imposible, sí existen estrategias para reducirlos:

- Usar datos diversos y de calidad

- Formar equipos de desarrollo más inclusivos

- Realizar auditorías y monitoreo continuo de los algoritmos

- Apostar por la transparencia y la responsabilidad

- Fomentar la conciencia crítica tanto en desarrolladores como en usuarios